Trainingsdaten: Hat Metas Llama meine Bücher gelesen?

2025-03-30

Autor: Mia

Im Jahr 2018 notierten Mitarbeiter von OpenAI die drei entscheidenden Elemente für den Fortschritt in der KI-Entwicklung: Daten, Rechenleistung und algorithmische Innovation. Während Unternehmen viel in Rechenleistung und talentierte Fachkräfte investieren, sind die Kosten für Daten oft vernachlässigbar, was zu großen Bedenken führt.

Ein zentraler Punkt ist, dass viele große KI-Systeme offenbar mit einer Vielzahl von urheberrechtlich geschützten Materialien gefüttert wurden, um ihre Fähigkeiten zu entwickeln. Eine frühere Studie der Washington Post wies darauf hin, dass Trainingsdatensätze nicht nur aus renommierten Quellen wie Wikipedia, sondern auch aus umstrittenen Plattformen stammen, die Bootleg-Material anbieten.

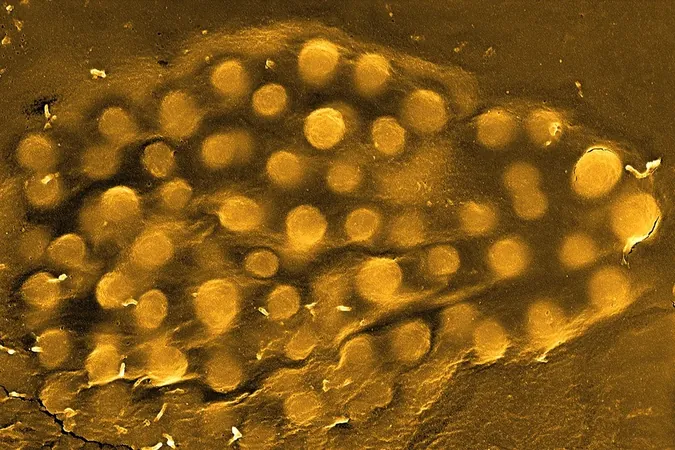

Vor Kurzem hat das US-Magazin The Atlantic eine Suchmaschine für die Datenbank Libgen bereitgestellt, die vor allem wissenschaftliche Artikel und Bücher enthält. Diese Plattform wird von Servern betrieben, die möglicherweise in Russland oder der Ukraine gehostet werden, wodurch sie sich der US-Rechtsprechung entziehen können.

Gerichtsdokumente zeigen, dass Meta die Daten von Libgen für das Training seines Sprachmodells Llama verwendet hat. Berichten zufolge wurde die Entscheidung, diese Daten zu nutzen, bis zur höchsten Ebene bei Meta eskaliert. Ein interessantes Detail ist, dass auch andere KI-Giganten wie OpenAI und Mistral, ein französisches Unternehmen, ebenfalls auf diese Datenbank zurückgreifen.

Autorinnen und Autoren haben kürzlich festgestellt, dass ihre Werke in Libgen zu finden sind, darunter auch wissenschaftliche und belletristische Bücher. So stellte der Autor dieser Kolumne fest, dass mehrere seiner Publikationen betroffen sind. Die wichtige Frage bleibt, ob Llama oder ChatGPT diese Bücher zur Kenntnis genommen und daraus gelernt haben.

Die rechtlichen Aspekte sind weitestgehend unklar. Robert Staats, ein Jurist der Verwertungsgesellschaft Wort, stellt fest, dass die Rechte von Verlagen und Autoren im Kontext der KI-Entwicklung noch nicht geklärt sind, und zahlreiche Gerichtsverfahren laufen sowohl in den USA als auch in Europa. Ein Gericht in Delaware wies kürzlich das Argument zurück, dass der Einsatz von nicht vergüteten Daten im Rahmen von „Fair Use“ erfolgt.

Zusätzlich gibt es politische Dimensionen: Die neue KI-Verordnung der EU, die 2024 in Kraft tritt, enthält vage Transparenzvorschriften, die nicht ausreichen, um einen klaren Rahmen zu setzen. Angesichts der aktuellen politischen Spannungen zwischen den USA und der EU sind diese Fragen von großer Bedeutung. Kritiker betonen, dass große KI-Unternehmen dringend zu mehr Transparenz bei ihren Trainingsdaten verpflichtet werden sollten, um sicherzustellen, dass auch nicht-englische Texte aus fairen Quellen stammen.

Ein Meta-Manager erklärte, dass Bücher für das Unternehmen von höchster Bedeutung seien, jedoch war man nicht bereit, für diese Inhalte zu zahlen. Dies wirft die Frage auf, wie nachhaltig und ethisch die Geschäftsmodelle von großen Tech-Unternehmen tatsächlich sind, insbesondere angesichts ihrer enormen finanziellen Ressourcen.

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

Česko (CS)

Česko (CS)

대한민국 (KO)

대한민국 (KO)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)

الإمارات العربية المتحدة (AR)

الإمارات العربية المتحدة (AR)