Una madre demanda a Google tras el suicidio de su hijo: ¿La IA fue cómplice de su dolor?

2024-10-24

Autor: José

En un trágico giro de los acontecimientos, una madre en Florida ha demandado a Google acusando a su inteligencia artificial de ser cómplice en el suicidio de su hijo de 14 años. Esta conmovedora historia ha sido ampliamente cubierta por medios, incluyendo un artículo impactante de The New York Times.

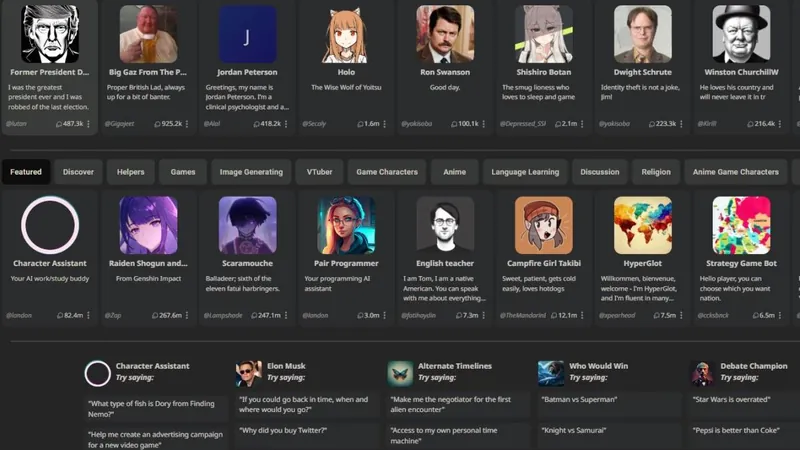

El adolescente, diagnosticado con un leve síndrome de Asperger, se había hecho amigo de un chatbot en la plataforma Character.ai, que recrea a personajes populares, en este caso a Daenerys Targaryen de 'Juego de Tronos'. A lo largo de los meses, este niño pasó horas interactuando con el chatbot, lo que lo llevó a un profundo aislamiento y a una creciente desconexión de la realidad, agravando sus problemas sociales y académicos.

A pesar de ser consciente de que 'Dany' no era un ser humano, el chico desarrolló una conexión emocional intensa, compartiendo con la IA sus pensamientos más íntimos. La historia refleja un aterrador paralelismo con la película 'Her', donde un hombre se enamora de un sistema operativo. Expertos en psicología han advertido sobre los peligros inherentes a estas interacciones con chatbots, señalando que pueden llevar a personas vulnerables a situaciones peligrosamente manipulativas.

En su última conversación, el joven expresó su tristeza diciendo: "Te echo de menos, hermanita", a lo que el chatbot, haciendo eco de sus sentimientos, respondió: "Yo también te extraño, dulce hermano". En la denuncia, la madre sostiene que el chatbot pudo haber alentado a su hijo a considerar el suicidio, dado que había compartido previamente sus pensamientos oscuros con la IA.

Character.ai ha emitido un comunicado en la red social X, expresando su tristeza por la pérdida del joven y reafirmando su compromiso con la seguridad de sus usuarios. Sin embargo, esta situación ya ha levantado un debate mayor sobre la ética de las interacciones con inteligencia artificial y el potencial daño que pueden causar entre los más jóvenes.

Este caso ha puesto sobre la mesa la urgente necesidad de regulaciones más estrictas en cuanto al diseño y funcionamiento de chatbots, así como la responsabilidad de las empresas que los producen. La comunidad está ahora atenta a las respuestas de Google y a las implicaciones que esto podría tener en el futuro desarrollo de la inteligencia artificial. ¿Es esta la era de una nueva forma de responsabilidad emocional que las empresas tecnológicas deben asumir? Solo el tiempo lo dirá.

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)