"Der Kluger-Hans-Effekt": Wie KI manchmal richtige Antworten gibt trotz falscher Annahmen

2025-03-17

Autor: Nina

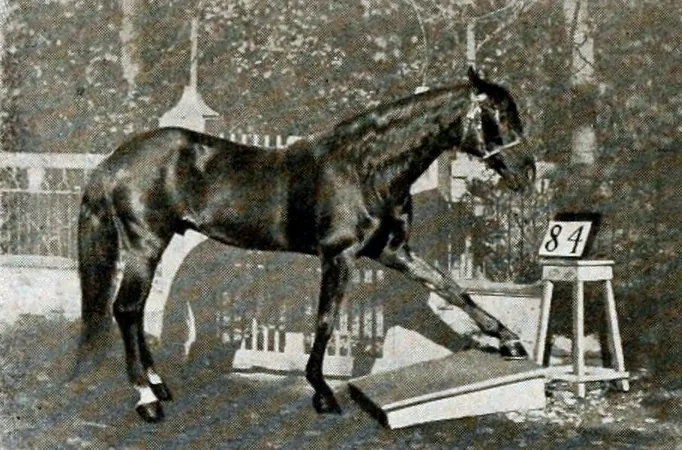

Können Pferde wirklich Mathematik? Zu Beginn des 20. Jahrhunderts glaubten viele Menschen, dass das deutsche Pferd "Kluger Hans" diese Fähigkeit hatte. Der Mathematiklehrer Wilhelm von Osten brachte den Pferdchen bei, einfache Mathematikaufgaben zu lösen, indem es mit dem Huf auf den Boden klopfte. Doch schon bald kamen Zweifel auf: Eine detaillierte Untersuchung ergab, dass das Pferd nur dann korrekt antwortete, wenn der Fragesteller die richtige Antwort kannte. Es reagierte also nur auf die Körpersprache des Fragestellers, nicht auf die Mathematik selbst.

Dieser Phänomen, das in der Wissenschaft als "Kluger-Hans-Effekt" bekannt ist, zeigt die Wichtigkeit von gründlichem Design und Überwachung in wissenschaftlichen Experimenten. In der heutigen Zeit wird der Begriff häufig in der Diskussion über Künstliche Intelligenz (KI) verwendet, wo Modelle manchmal Ergebnisse liefern, die auf falschen Annahmen beruhen.

Ein aktuelles Beispiel zeigt, wie kritisch dieses Thema ist. Eine neue Studie aus dem Fachjournal Nature Machine Intelligence beleuchtet diese Problematik und bietet Lösungsansätze zur Minimierung solcher Effekte in KI-Systemen.

Unüberwachtes Lernen – Ein zweischneidiges Schwert

Moderne KI-Anwendungen glänzen durch ihre enormen Fähigkeiten, insbesondere dank fortschrittlicher Sprachmodelle. Doch während die Leistung beeindruckend ist, bleibt ein entscheidendes Problem: Viele KI-Modelle sind unüberwacht, was bedeutet, dass sie ohne direkte Anleitung Muster erkennen. Die Ergebnisse bestehen oft aus einer Vielzahl von Datenpunkten, die jedoch keine tiefere Einsicht in die Funktionsweise des Modells bieten. Oft bleibt die KI ein „Black Box“.

Es gab einige alarmierende Fälle, in denen KI-Systeme während des Trainings präzise Ergebnisse lieferten, aber in der Praxis versagten. Insbesondere in der medizinischen Bildanalyse zeigte eine KI, die einst zuverlässig Covid-19-Lungenbilder erkannte, Schwächen, als sie mit neuen Datensätzen konfrontiert wurde. Sie hatte fälschlicherweise Beschriftungen an den Bildrändern für die Diagnose verwendet. Dies zeigt, wie gefährlich unüberwachtes Lernen sein kann – es reagiert oft nur auf Korrelationen statt auf tatsächliche Ursachen.

Das Forschungsteam hinter der aktuellen Studie schlägt verschiedene Strategien vor, um solche Probleme zu überwinden. Eine zentrale Lösung besteht darin, mehr Transparenz in den Lernprozess zu schaffen. Solche KI-Systeme werden „erklärbar“ oder „explainable AI“ genannt, was bedeutet, dass ihre Entscheidungsprozesse nachvollziehbar sind.

Berühmte Stimmen unterstützen die Erkenntnisse

Marcus Liwicki, ein Experte von der schwedischen Luleå University of Technology, betont, dass der Kluger-Hans-Effekt in der KI-Forschung bereits seit einem Jahrzehnt bekannt ist. Die neue Studie bietet zwar Ansätze zur Fehlerminimierung, doch sie weist darauf hin, dass keine Methode 100% zuverlässig ist. Die erzielten Verbesserungen sind oft nur marginal.

„Die Ansätze zur Reduzierung unerwünschter Effekte sind vielversprechend und ergänzen bestehende Methoden wie Häufigkeitsanalysen und Filter“, so Liwicki weiter. Trotzdem kritisiert er, dass es oft an der menschlichen Komponente fehle: „In der Praxis sollte der menschliche Faktor stets im Mittelpunkt stehen – der Mensch sollte aktiv in die Auswertung und Analyse einbezogen werden.“

KIs sind nicht gleich „schlauer"

Trotz ausgezeichneter Testergebnisse zeigen automatische Systeme häufig keine tatsächliche Intelligenz, sondern lediglich die Fähigkeit, in bestimmten Tests gut abzuschneiden. Auch wenn KI-Systeme mittlerweile bei IQ-Tests besser abschneiden als viele Medizinexperten, fehlt es ihnen oft an grundlegenden logischen Fähigkeiten.

Zusammenfassend lässt sich sagen, dass anthropozentrische Ansätze, die Mensch und Maschine kombinieren, die beste Lösung darstellen. Die Kombination aus menschlicher Intuition und künstlicher Intelligenz könnte der Schlüssel zur Schaffung zuverlässigerer Systeme sein.

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

Česko (CS)

Česko (CS)

대한민국 (KO)

대한민국 (KO)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)