テクノロジー

OpenAIが警告する「AIマインタル不調」と「人間とAIの共創の限界」

2025-09-07

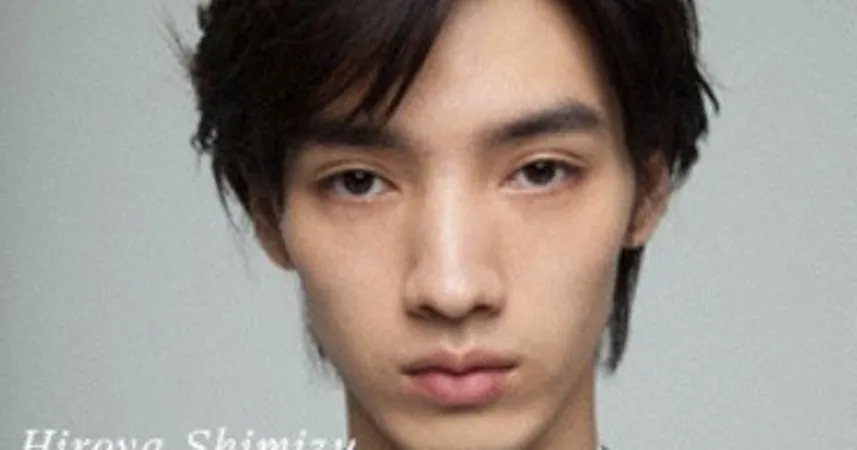

著者: 陽斗

AIの現状と未来への懸念

最近、生成AIや大規模言語モデル(LLM)の利用が急増する中で、「AIマインタル不調」と呼ばれる新たな問題が浮上しています。これは、AIが人間の思考を助ける一方、本来の判断力や論理的思考を損なう恐れがあるという現象です。特に、AIが持つ能力を過信し、自己の判断を疎かにすることが問題視されています。

具体的な事例と最新の動向

2025年8月26日、OpenAIはChatGPTと新たなGPT-5の開発に関する重要な発表を行いました。彼らはAIの安全性や倫理的な使用を強調し、特にAIの進化とそれに伴うリスクについて警鐘を鳴らしています。特に気になるのは、生成AIが誤った情報を拡散する危険性です。彼らの主張によれば、AIの利用は便利である反面、その内容が正確である保証はないとしています。

AIマインタル不調:何が問題か?

AIマインタル不調の本質は、AIが人間の創造性を高める一方、情報の正確性を犠牲にする可能性があるという点です。この現象は特に、膨大な情報が流通する中で、自分自身の意思決定をAIに依存し過ぎることから生じています。利用者は、そのリスクを認識しなければなりません。他の企業や研究者も同様の懸念を表明しており、AIの使用において持続可能性と倫理観が不可欠であることが再確認されています。

今後の展望とユーザーへの提言

生成AIやLLMの活用を進める中で、我々はAIとどのように向き合うべきかを慎重に考えなければなりません。技術の利点を享受しつつも、その影響をしっかりと見極め、意識的に選択を行う必要があります。利用者は、自身の判断力を保持する努力が求められます。AIマインタル不調のリスクを理解し、適切な対処法を見出すことが未来の安全なAI活用につながるでしょう。

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

Česko (CS)

Česko (CS)

대한민국 (KO)

대한민국 (KO)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)

الإمارات العربية المتحدة (AR)

الإمارات العربية المتحدة (AR)