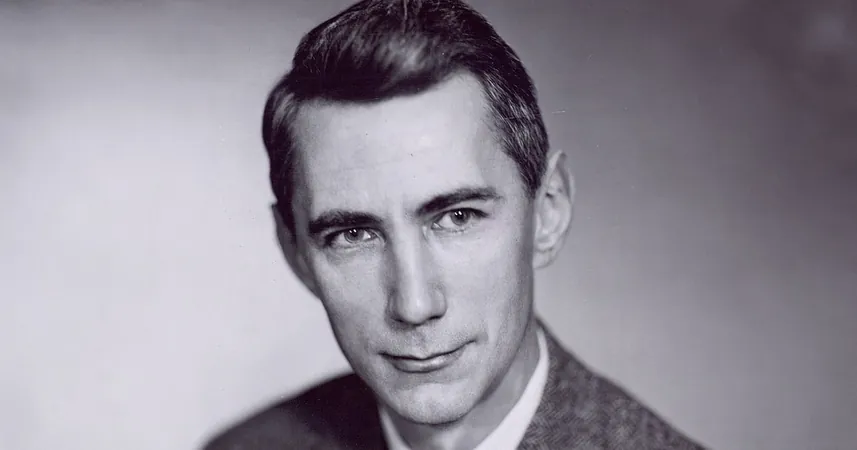

Claude Shannon: El genio de la teoría de la información que revolucionó la tecnología moderna

2025-03-14

Autor: Martina

Claude Elwood Shannon: Inicios y educación

Claude Elwood Shannon nació el 30 de abril de 1916 en Petoskey, Michigan. Desde una edad temprana, demostró una curiosidad insaciable por los dispositivos a su alrededor. En su infancia, no solo reparaba radios, sino que también creaba juguetes y experimentaba con los componentes tecnológicos que encontraba. Esta inclinación por la ingeniería y las matemáticas lo guiaría hacia una trayectoria que transformaría la historia de la computación y las telecomunicaciones.

Una mente revolucionaria

Durante su niñez y adolescencia, ya era evidente que Shannon poseía una mente extraordinaria y visionaria, como menciona un artículo de Spectrum. Estudios en la Universidad de Michigan y posteriormente en Princeton, donde obtuvo su doctorado en matemáticas en 1940, lo posicionaron como un líder innovador.

Contribuciones a la criptografía

Su tesis doctoral, “Un análisis simbólico de los circuitos de relés y de conmutación”, fue revolucionaria. Aplicando la lógica booleana, formulada por el matemático británico George Boole, Shannon desarrolló modelos matemáticos que sentaron bases fundamentales para la programación de computadoras y la computación digital. Después de finalizar su doctorado, Shannon se unió a los Laboratorios Bell, donde su trabajo lo condujo a la creación de la teoría matemática de la criptografía durante la Segunda Guerra Mundial. Transformó la criptografía de un arte en una ciencia, creando teorías que permitieron codificar y descifrar mensajes de forma segura. Su influyente artículo “Una teoría matemática de la criptografía” propuso métodos para proteger la comunicación moderna.

La revolución de la teoría de la comunicación

Sin embargo, la verdadera revolución de Shannon llegó con su artículo “A Mathematical Theory of Communication”, publicado en 1948, donde estableció las bases para entender cómo se transmiten los datos hoy en día. Introdujo el concepto de “entropía de la información”, tomando prestado un término de la física, que se refiere a la incertidumbre en la comunicación de datos. Aclaró la definición de “bit”, la unidad básica de información que se convirtió en fundamental para la computación digital.

Un creador excéntrico

A pesar de su reconocimiento en el ámbito académico, Shannon se mantuvo alejado de la fama. Prefirió trabajar en el anonimato, centrado en la resolución de problemas complejos y la creación de nuevos dispositivos. Era un personaje excéntrico que, según sus colegas, solía desplazarse en monociclo mientras hacía malabares en los pasillos de los Laboratorios Bell.

Inventos notables

Uno de sus inventos más notables fue el “ratón mecánico” llamado “Theseus”, capaz de encontrar su camino a través de un laberinto, un precursor de lo que hoy entendemos como inteligencia artificial. Además, desarrolló una máquina para jugar ajedrez, exhibiendo su capacidad para resolver problemas de forma innovadora, aunque algunos de sus inventos carecían de aplicaciones prácticas.

Legado e influencia

A lo largo de las décadas de 1950 y 1960, Shannon continuó su labor innovadora, anticipando avances tecnológicos que se materializarían mucho tiempo después. Desarrolló una “máquina que leía la mente” y una calculadora que realizaba cálculos utilizando números romanos.

La visión de Shannon fue tan única que a menudo destacó su enfoque despreocupado hacia la utilidad de sus inventos, afirmando: “Hago lo que me sale naturalmente, y la utilidad no es mi objetivo principal”. Su legado no solo incluye la teoría de la información, sino también una forma singular de ver el mundo, que continúa inspirando a científicos e ingenieros en la actualidad.

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

Česko (CS)

Česko (CS)

대한민국 (KO)

대한민국 (KO)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)